La tan mencionada inteligencia artificial, conocida como IA, existe desde hace décadas y está presente en todos los aspectos de la vida diaria. Desde los programas o ‘softwares’ de reconocimiento facial hasta los asistentes virtuales de los teléfonos inteligentes o ‘smartphones’. Las sugerencias de noticias y vídeos en redes sociales o las experiencias de compra ‘online’ también se rigen por esta tecnología. La IA también se ha aplicado a vehículos autónomos o robots que ahora interactúan con humanos en hospitales, centros comerciales y escuelas, entre otros.

Pero todo indica que el 2022 fue el año de coronación de la IA generativa, y que el 2023 se caracterizó por una mayor innovación, desarrollo y disponibilidad de tecnologías de IA. Se anticipa que en el 2024 la integración de la IA en los servicios de salud alcanzará un nivel récord en sus usos; mientras que el marco político y regulatorio para la IA seguirá cambiando.

No hay duda de que la IA tiene el potencial de transformar la atención médica, pero también conlleva riesgos conocidos y otros aún no comprendidos. La regulación de la IA es un tema complejo y requiere de expertos en la materia.

Trasfondo regulatorio

Si en algo están de acuerdo todos los que estudian el tema, es en que las organizaciones de salud deben comenzar el 2024 con una comprensión clara de su estrategia y prioridades de IA, así como de los riesgos asociados con ella. Para lo anterior, en la discusión sobre las potenciales adquisiciones es indispensable que se incluya a los manejadores de riesgo y calidad, así como a los asesores legales de las instituciones.

Si bien no existe una ley universal actual que rija la IA, existen varias disposiciones en leyes y regulaciones que son anteriores a la IA y que aplican a su uso. Entre ellas están las relacionadas con la privacidad, protección del consumidor, estándares de atención médica y tecnología de la información de la salud.

Toda entidad que pretenda adquirir tecnología de ese tipo debe tener un entendido claro sobre el referido marco regulatorio actual. Además, es fundamental un claro entendimiento de su naturaleza cambiante.

En ausencia de una regulación federal de amplia visión que ocupe el campo de la IA, por el momento los responsables de la formulación de políticas están realizando esfuerzos para abordar las deficiencias. Aquí se incluyen el plan de la Casa Blanca en Washington DC, y los compromisos voluntarios de las principales empresas de IA para desarrollar una IA segura y confiable.

Discusión local del tema

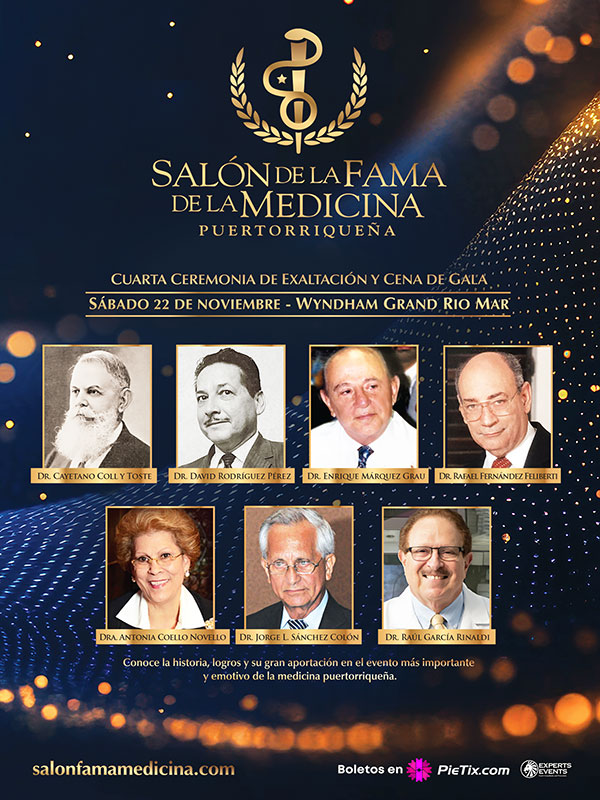

En Puerto Rico se generó una interesante discusión sobre la IA el 20 de octubre de 2023. Ocurrió durante la tan esperada convención anual de la Asociación de Hospitales de Puerto Rico (AHPR). Allí se llevaron a cabo varias sesiones educativas dirigidas a discutir el tema. En esa ocasión, los presentes pudieron escuchar varios enfoques, a cargo del ingeniero Emmanuel Oquendo, la doctora Jessica Santiago, y por último, el licenciado Jorge C. Pizarro y esta servidora.

Poco después, el 30 de octubre, el presidente Joe Biden publicó una orden ejecutiva histórica con una serie de directivas para establecer normas para la seguridad y la protección de la IA. Incluyó los contextos de la ciberseguridad, la equidad, los derechos civiles, la privacidad y la protección de los consumidores contra el fraude y el engaño. Esta acción presidencial no solo refleja un reconocimiento de la influencia transformadora de dicha tecnología en la ciencia, la economía y la sociedad, sino también de los peligros que puede representar si no se regula adecuadamente.

Incluso, casi simultáneamente, salieron varias directrices para que el Departamento de Salud y Servicios Humanos de Estados Unidos (HHS, por sus siglas en inglés) cree programas de seguridad, garantía y supervisión de la IA en el área de la salud. Por ejemplo, el 14 de diciembre de 2023, la Casa Blanca anunció que 28 organizaciones de proveedores de salud y pagadores se habían comprometido voluntariamente a ayudar a avanzar hacia la compra y uso de la tecnología IA de forma segura y confiable.

También, ya al despedir al 2023, el 8 de diciembre, pasó a la historia como el día en el que se aprobó la primera ley para regular la inteligencia artificial en el mundo. Ese hito fue protagonizado por la Unión Europea y presenta un marco de actuación de referencia en el plano global.

Evaluación caso a caso

Es claro el reconocimiento de que el entorno regulatorio de la IA será cambiante y de forma rápida. Por lo tanto, es esencial evaluar los casos de uso de la IA en Puerto Rico utilizando un enfoque caso a caso. Hay que considerar los distintos marcos legales existentes, con un monitoreo constante de los cambios políticos y regulatorios, para ayudar a entender los riesgos actuales y prepararse para futuras regulaciones de IA.

Algunos de los riesgos que fueron discutidos en la asamblea anual de la AHPR y otros que les traigo a su atención son: riesgos de privacidad, seguridad y tecnología; consideraciones regulatorias de la FDA (Administración de Drogas y Alimentos); consideraciones sobre la propiedad intelectual; confiabilidad de los productos o sistemas; y gobernanza responsable de la IA al interior de las instituciones de salud.

Las tecnologías de IA dependen de una gran cantidad de datos. Y sabemos que cualquier uso de los datos de salud desencadena preocupaciones sobre la privacidad y la seguridad. Es por eso por lo que el equipo que propongo será parte crucial en la evaluación todo tipo de IA. Considero que para hacerlo adecuadamente deben tener presentes a su Oficial de Privacidad y Seguridad para una discusión coherente e inclusiva sobre los requisitos de privacidad existentes, que incluyen estatutos como la Ley de Portabilidad y Responsabilidad de los Seguros Médicos (mejor conocida como HIPAA, sus siglas en inglés).

De igual manera, las divisiones legales internas de las instituciones de salud deben evaluar la Ley de la Comisión Federal de Comercio, las leyes estatales de privacidad del consumidor, las leyes internacionales como el Reglamento General de Protección de Datos (GDPR), los esquemas regulatorios nuevos y en desarrollo, así como los términos contractuales que pueden restringir cómo se pueden usar y divulgar los datos, y la manera como éstos deben protegerse.

Es importante que se tomen en consideración herramientas como el ‘Marco de Gestión de Riesgos de IA 6’ del Instituto Nacional de Estándares y Tecnología de Estados Unidos para ayudar a las organizaciones a administrar mejor la seguridad, la tecnología y otros riesgos asociados con la IA.

En cuanto a la FDA, crea requisitos para las tecnologías de IA utilizadas en dispositivos médicos, incluido tanto el ‘software’ como el propio dispositivo médico. Por ejemplo, la FDA regula las herramientas de imágenes que utilizan IA que ayudan en el diagnóstico y el ‘software’ que utiliza datos específicos del paciente. De hecho, hay unos nuevos requisitos para las tecnologías de IA que podrían usarse en contextos clínicos, administrativos y operativos, y que son suministrados por los desarrolladores de tecnología.

Reflexión final

Durante todas las conferencias y escritos que hemos consultado, una de las principales preocupaciones en torno al uso de la IA en la atención de salud es la posibilidad de desigualdades y sesgos que han plagado durante mucho tiempo la atención médica en Estados Unidos. El consenso es que el uso responsable de la IA en el ámbito de instalaciones de salud (ya sea hospital, CDT u oficina médica) requiere de forma indispensable, dentro de la misma organización, la creación de programas de supervisión efectivos y de manejo de riesgos.

Ya sea que su organización esté desarrollando, adquiriendo o implementando una tecnología habilitada para IA, tiene que haber un enfoque basado en una clara gobernanza de IA que pueda identificar riesgos e informar cómo administrarlos.

Entiendo que los riesgos reales vendrán de máquinas que aún no son lo suficientemente inteligentes y sensibles como para manejar las responsabilidades que los humanos les dan. Participar en la supervisión a lo largo de todo el ciclo de vida de la IA y someterla al mismo escrutinio que otras nuevas tecnologías, utilizando los marcos legales existentes, puede ayudar a gestionar y controlar esos riesgos.

Una pregunta clave es si estos desarrollos tecnológicos nos están ayudando a crear sociedades más equitativas, más sustentables, menos desiguales, menos discriminadoras que lo que tenemos actualmente.

Por último, antes de utilizar la IA, las organizaciones de salud deben evaluar su uso con un análisis que atienda las cuestiones éticas, la autonomía humana, la prevención del daño y la equidad.

Lcda. Marie Carmen Muntaner

Asesora Legal AHPR